🗣 SL提问: ai 写作训练

✍️ Ai批改: AI写作训练是指利用人工智能技术对写作模型进行训练,使其能够生成类似人类写作风格和内容的文本。以下是一些AI写作训练的基本步骤和技巧:

1、数据收集

多样化文本收集: 收集大量的文本数据,这些数据可以是来自书籍、文章、博客等各种来源的文字内容。

特定领域数据: 如果你想让AI模型专注于某一特定领域的写作,收集的数据应与该领域相关。

2、数据预处理

清理数据: 清除不相关的信息,如HTML标签、特殊字符等。

分词: 将文本分解为单个的词或短语(tokens),这是后续处理的基础。

3、选择算法和模型

选择合适的算法: 根据写作任务的性质,选择合适的机器学习或深度学习算法,如循环神经网络(RNN)、长短期记忆网络(LSTM)、变换器(Transformer)等。

预训练模型: 利用已经预训练好的语言模型,如BERT、RoBERTa等,进行进一步的微调。

4、模型训练

定义训练目标: 根据需求定义训练目标,如生成风格、语气、长度等。

训练模型: 使用收集和预处理好的数据训练模型。在这个过程中,调整模型参数以优化其性能。

5、评估和调整

评估指标: 使用适当的评估指标,如BLEU分数、ROUGE分数等,来衡量模型的性能。

模型调整: 根据评估结果,调整模型参数、训练数据或算法,以提高模型性能。

6、测试和应用

模型测试: 在测试集上评估训练好的模型,确保它在未知数据上的表现符合预期。

实际应用: 将训练好的模型用于实际的写作任务中,如内容生成、文本摘要、创意写作等。

技巧和建议

多样性和质量: 确保训练数据的多样性和高质量,这对模型的泛化能力至关重要。

伦理考虑: 注意AI生成内容的伦理问题,避免产生误导性或有害内容。

持续学习: AI模型可以从新的数据中继续学习,因此持续的数据更新和模型微调可以保持模型的先进性。

示例:使用Python和Hugging Face的Transformers库进行文本生成

python

from transformers import T5Tokenizer, T5ForConditionalGeneration

加载预训练模型和分词器

model = T5ForConditionalGeneration.from_pretrained('t5-small')

tokenizer = T5Tokenizer.from_pretrained('t5-small')

编码输入文本

input_text = 写一篇关于人工智能的文章。

inputs = tokenizer.encode(generate a article about AI, return_tensors=pt)

生成文本

outputs = model.generate(inputs, max_length=200)

解码输出文本

generated_text = tokenizer.decode(outputs[0], skip_special_tokens=True)

print(generated_text)

这个例子展示了如何使用预训练的T5模型生成文本。你可以根据自己的需求调整模型、输入和参数,以适应不同的写作任务。

0

IP地址: 249.216.81.11

搜索次数: 3

提问时间: 2025-04-19 21:22:28

❓️ 热门提问:

ai自动谱曲软件

pubg注册邮箱地址

工商银行金条多少克

橙域名注册

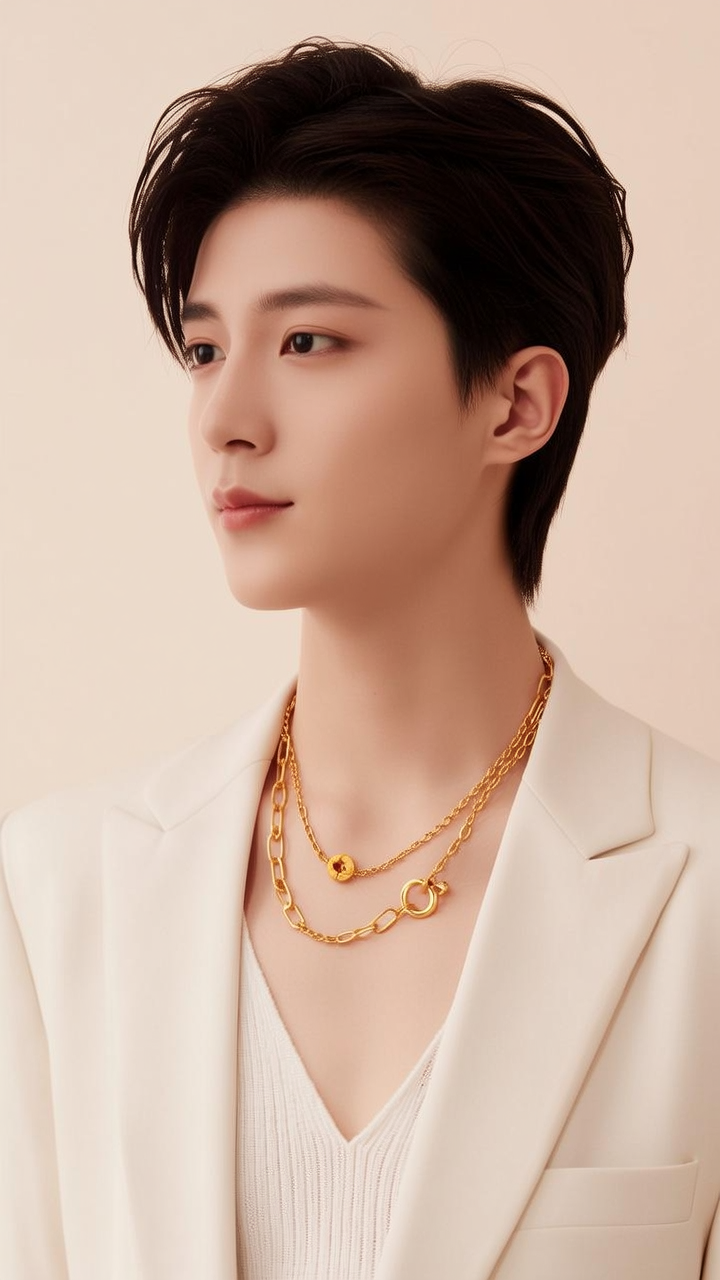

金戒指 男士

0.8克金子值多少钱

成都黄金批发市场在哪里

购买金项链

10k金耳钉

详细介绍域名www.ff.nm.cn的含义、价值与适合的行业。

豌豆Ai站群搜索引擎系统

🤝 关于我们:

三乐Ai

作文批改

英语分析

在线翻译

拍照识图

Ai提问

英语培训

本站流量

联系我们

📢 温馨提示:本站所有问答由Ai自动创作,内容仅供参考,若有误差请用“联系”里面信息通知我们人工修改或删除。

👉 技术支持:本站由豌豆Ai提供技术支持,使用的最新版:《豌豆Ai站群搜索引擎系统 V.25.05.20》搭建本站。